초록배경 및 목적고기능 자폐범주성장애(HF-ASD) 아동들이 나타내는 또래의 얼굴표정에 대한 정서인식 특성을 시선응시 패턴 측면에서 살펴보고 일반(TD) 아동과 비교하여 시사점을 제안하고자 하였다.

방법7-8세 HF-ASD 아동 10명과 생활연령을 일치시킨 TD 아동 10명을 대상으로 하였다. 아동들은 4가지 기본정서(기쁘다, 슬프다, 화나다, 놀랍다)에 대해 두 가지 자극유형(사진, 동영상)으로 구성된 정서인식 과제를 실시하였으며, 과제를 실시하는 동안 시선추적기를 사용하여 시선응시 패턴을 측정하였다. 정서인식 정반응률과 시선고정비율 및 열지도를 분석하였으며, 상관분석을 실시하였다.

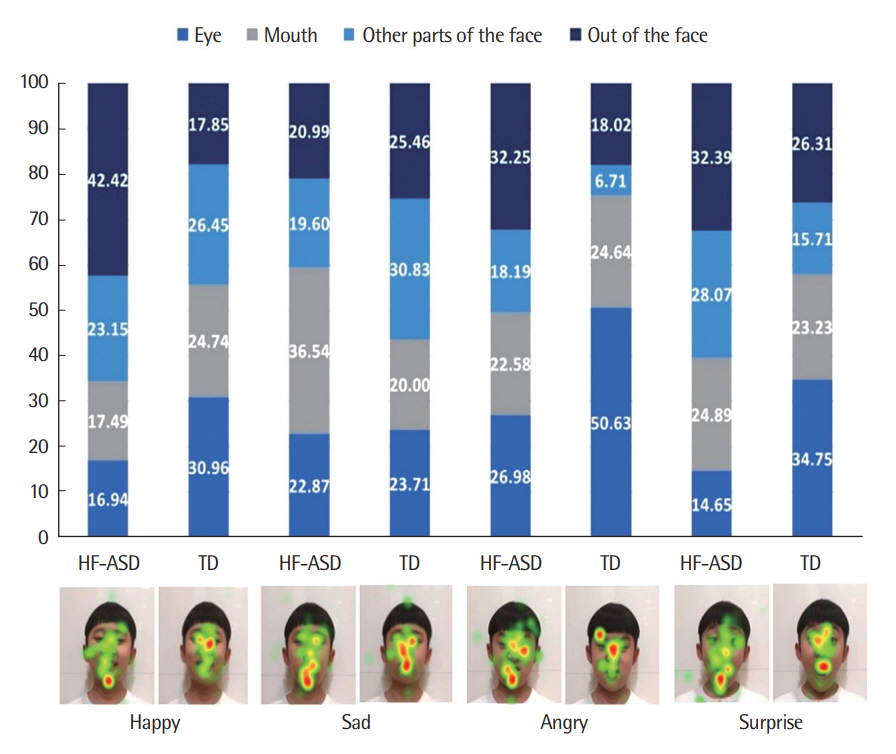

결과HF-ASD 집단이 TD 집단보다 정서인식 전체 정반응률과 정서 유형 중 ‘화나다’에서 유의하게 낮은 인식을 보였다. 사진과 동영상에 따른 정반응률에서 두 집단 모두 유의한 차이가 나타나지 않았다. 집단과 정서유형 및 AOI 간 상호작용 효과가 없었으며, TD 집단에서만 정서유형과 AOI 간 상호작용 효과가 유의하였다. HF-ASD 집단은 TD 집단에 비해 눈보다 입에 시선을 고정하는 비율이 높았으며, 얼굴의 핵심적이지 않은 영역을 더 많이 보았다. 또한 이러한 시선응시 패턴이 정서유형별 정반응률에 영향을 미치는 것으로 나타났다.

AbstractObjectivesThe purpose of the present study was to investigate characteristics of peer’s facial emotion recognition (FER) in children with high-functioning autism spectrum disorder (HF-ASD) through gaze patterns; and to suggest implications through comparison with typically developing (TD children).

MethodsThe participants were 10 children with HF-ASD aged 7-8 years and 10 children with TD matched on chronological age. Children performed FER tasks consisting of two types of stimuli (static, dynamic) for four basic emotions (happy, sad, anger, surprise) and their eye movement were measured while they performed the task using an eye-tracker. The emotion recognition accuracy, proportion of fixation, and heatmap were analyzed, and correlation analysis was conducted.

ResultsThe HF-ASD group performed significantly poorer than the TD group in overall emotion recognition and made significantly more errors only in anger. There was no statistically significant difference in emotion recognition between static and dynamic stimuli in both groups. There was no interaction effect between group and emotion type and areas of interest (AOI). Only the interaction effect between emotion type and AOI was significant in the TD group. The HF-ASD group tended to look more at the mouth than the eyes and look relatively more at non-feature area of the faces compared to the TD group. These gaze patterns seem to affect the accuracy depending on emotion types.

성공적인 의사소통을 위해서 타인의 정서를 이해하고 공감하는 것은 매우 중요하다. 정서는 개인의 다양한 심리상태를 일컫는 것으로 이를 표현하기 위해 언어로 직접적인 표현을 하거나, 얼굴표정이나 목소리, 몸짓 등을 사용하여 간접적으로 나타내기도 한다. 따라서 타인의 정서를 판단하기 위해서는 상대방의 말을 잘 듣고 이해할 뿐만 아니라, 타인의 얼굴표정, 목소리, 몸짓 등의 비언어적 단서에도 주의를 기울여야 한다. 특히 얼굴표정은 정서 상태를 반영하는 비언어적 단서 중 가장 강력한 신호로(Ekman, 1982), 얼굴표정을 통해 상대방의 정서뿐만 아니라 동기와 의도를 파악할 수 있어 의사소통과 밀접한 관련이 있다.

정서인식 연구들은 타인의 얼굴표정에 나타난 정서를 인식하는 능력이 매우 어린 영아시기부터 발달하기 시작하여 연령이 증가함에 따라 발달하지만, 정서유형, 자극유형, 정서를 판단하는 데 근거가 되는 얼굴부위에 따라 인식에 차이가 있다고 보고하였다(Ambadar, Schooler, & Cohn, 2005; Kostić, Jakšić, & Tošković, 2020; LaBarbera, Izard, Vietze, & Parisi, 1976; Nelson & Dolgin, 1985; Walden & Field, 1982).

정서유형에 따른 얼굴표정 정서인식 능력의 발달을 살펴본 연구들은 일반적으로 5-6세에 기쁨과 슬픔을 나타내는 표정을 정확히 인식하고, 약 10-11세에 대부분의 감정을 성인과 유사한 수준으로 인식할 수 있다고 보고하였다. 기본적인 정서유형에 따른 일반적 발달 순서는 국외는 기쁨, 슬픔, 화남, 놀람의 순이며, 국내는 기쁨, 슬픔, 놀람, 화남으로 나타나 가장 늦게 발달하는 정서유형에서 문화권에 따른 차이를 보였다(Durand, Gallay, Seigneuric, Robichon, & Baudouin, 2007; Lawrence, Campbell, & Skuse, 2015; Shim & Choi, 2001; Yi, Cho, & Ghim, 2012).

얼굴표정을 통한 정서인식에서 단서가 되는 특정 얼굴영역의 상대적 중요성에 대한 연구들도 문화 및 연령에 따라 다른 결과를 보고하였다. 서양권 성인을 대상으로 한 연구들에서는 기쁨은 입 영역, 슬픔과 놀람은 눈 영역, 화남은 눈과 입 영역의 중요성이 유사한 것으로 나타난 반면(Beaudry, Roy-Charland, Perron, Cormier, & Tapp, 2014; Hanawalt, 1944), 3-5세 아동을 대상으로 한 Walden과 Field (1982)는 기쁨과 화남은 눈 영역, 슬픔과 놀람은 눈과 입 영역의 중요성이 유사한 것으로 보고하였다. 국내 성인을 대상으로 한 Lee, Park, Han, Ghim과 Cho (2007)는 기쁨과 놀람은 입 영역, 그리고 화남과 슬픔 등은 눈 영역이 더 중요한 것으로 나타났다. 이와 같이 연구들은 화남에 대해서는 공통적으로 눈의 중요성을 제시하였으나 그 외 기본 정서들에서는 차이가 있었다.

얼굴표정을 제시하는 자극유형에 따른 정서인식의 정확도 측면에서는 대상자들이 사진보다 동영상에서 얼굴표정을 더 잘 인식하는 것으로 나타났다(Ambadar et al., 2005; Lee et al., 2007; Nelson & Mondloch, 2018). 5-8세 아동들을 대상으로 성인과 또래의 얼굴에 대한 인식을 비교한 Anastasi와 Rhodes (2005)는 아동들이 성인보다 또래 얼굴을 더 정확하게 인식함을 밝혀 자극 모델에 대한 자기 연령 편향이 존재함을 나타냈다.

사회적 상호작용의 결함이 주 특징인 자폐범주성장애 아동들은 타인의 입장이나 감정에 대한 인식이 부족하며, 특히, 얼굴표정, 자세, 시선 등과 같은 비언어적인 단서들에 대한 이해와 사용의 결함으로 의사소통에 더 어려움을 겪는 경우가 많다. 자폐범주성장애 집단의 정서인식에 대한 대부분의 연구들은 이들이 일반 집단에 비해 기본 정서인식에 어려움을 나타낸다(Lozier, Vanmeter, & Marsh, 2014; Uljarevic & Hamilton, 2013)고 보고하였다.

자폐범주성장애 집단의 정서인식 수준은 정서유형과 제시 자극 유형에 따라 차이를 보인다. 많은 연구들에서 자폐범주성장애 집단은 화남이나 슬픔, 두려움, 혐오와 같은 부정적 정서유형의 인식에서 더 큰 결함을 보였으며(Ashwin, Chapman, Colle, & Baron-Cohen, 2006; Bal et al., 2010; Chae & Hong, 2015; Enticott et al., 2014), 자극유형면에서는 7-18세 자폐범주성장애 집단이 사진 자극을 제시했을 때 기본 정서들에 대한 인식 수준에서 일반 또래와 차이를 보이지 않은 반면(Grossman, Klin, Carter, & Volkmar, 2000), Jelili 등(2021)에서는 7-12세 자폐범주성장애 아동들이 공포와 기쁨을 제외하고 슬픔, 화남, 놀람, 혐오에서 사진과 동영상 자극 유형에서 모두 낮은 인식 수준을 보였고, 5-16세 아스퍼거증후군 아동들을 대상으로 한 Lindner와 Rosen (2006)에서는 기쁨, 슬픔, 화남에서 두 자극유형 모두 낮은 인식을 보였다. 자폐범주성장애 아동들이 타인의 얼굴표정에서 정서를 인식할 때 근거가 되는 얼굴 부위를 살펴본 연구들(Langdell, 1978; Syeda et al., 2017)은 이들이 해당 감정별로 주요 단서가 되는 눈, 코, 입과 같은 핵심 영역보다 머리카락, 귀, 목 등과 같은 정서인식에 핵심적이지 않은 얼굴 영역이나 배경을 더 많이 보고, 얼굴표정의 종합적 분석보다는 개별적 영역에만 초점을 맞추는 경향을 보임으로써 타인의 감정을 이해하는데 어려움을 겪는다고 해석하였다.

자폐범주성장애 집단의 정서인식 결함이 얼굴의 특정 영역에 대한 시각적 주의나 회피에 원인이 있다는 관점들은 시선추적기(eye tracker)와 같은 기술을 활용하여 보다 객관적인 근거를 제시할 수 있다. 시선추적이란 적외선을 사용하여 눈동자의 움직임을 추적하는 기술로, 시각적 처리 과정을 설명하는 데 유용한 도구이다. 시선추적을 활용한 연구에서는 주로 미리 지정한 관심영역(Areas of Interest, AOI)에 대한 시선고정시간(fixation duration)이나 시선고정횟수(fixation count) 등의 측정값을 분석하여 얼굴표정과 같은 비언어적 정보를 주고받는 상황에서 개인의 주의가 향하는 특정 영역에 대한 정보를 활용한다(Rayner, 1995). 따라서 아주 어린 유아나 구어 사용에 제한을 보이는 자폐범주성장애 아동의 반응을 해석할 수 있는 객관적인 지표라 할 수 있다.

시선추적을 활용하여 얼굴표정 인식 시 얼굴의 세부 영역에 대한 시선응시 패턴을 살펴본 Van Der Geest, Kemner, Verbaten과 Van Engeland (2002)에서 자폐범주성장애 아동들은 일반 또래와 유사한 눈 영역 시선고정시간과 정서별 핵심 얼굴 영역에 더 긴 응시 패턴을 나타냈으나, Bal 등(2010)은 이들이 일반 아동들보다 눈을 적게 응시하고, 핵심 영역보다 입이나 기타 부위를 더 많이 응시했다고 보고하였다. 이러한 비일관적인 연구결과들은 자폐범주성장애 집단의 얼굴표정 정서인식 특성에 대하여 좀 더 다양한 문화, 연령, 자극유형 및 핵심 얼굴 부위 등의 변인을 포함한 연구의 필요성을 시사한다.

특히 국내에서 자폐범주성장애 아동들의 얼굴표정에 대한 정서인식 특성을 살펴본 연구는 매우 부족한 실정이며, 또래 아동의 얼굴표정에 대한 정서인식 능력이나 시선추적기와 같은 객관적인 방법으로 얼굴표정에 대한 정서인식의 특성을 분석한 연구는 이루어지지 않았다.

따라서, 본 연구는 7-8세 고기능 자폐범주성장애 아동들이 나타내는 또래의 얼굴표정에 대한 기본 정서인식 수준을 분석하고 정서인식의 특성을 시선응시 패턴 측면에서 분석하는 데 목적이 있었다. 이를 위하여 고기능 자폐범주성장애 아동과 생활연령이 동일한 일반 아동의 두 집단을 대상으로 또래 얼굴표정에 대한 정서인식 수준을 비교하고 그 특성을 시선추적기를 이용하여 비교 분석하였다. 본 연구의 구체적인 연구문제는 다음과 같다.

첫째, 7-8세 고기능 자폐범주성장애 아동 집단과 생활연령을 일치시킨 일반 아동 집단은 정서인식 정반응률에서 전체 정반응률, 정서유형(기쁘다, 슬프다, 화나다, 놀랍다), 자극유형(사진, 동영상)에 따른 집단 간 차이 및 집단, 정서유형, 자극유형 간 상호작용 효과가 있는가?

둘째, 두 집단은 정서유형과 AOI (눈 주위, 입 주위, 그 외 얼굴, 얼굴 이외)에 따른 시선고정비율에서 정서유형 및 AOI에 따른 집단 간 차이 및 집단, 정서유형, AOI 간 상호작용 효과가 있는가?

셋째, 집단, 정서유형별 정반응률, 자극유형, AOI별 시선고정비율 간 유의한 상관관계가 있는가?

연구방법연구대상본 연구의 대상은 7-8세 고기능 자폐범주성장애 아동(high-functioning autism spectrum disorder, HF-ASD) 10명과 생활연령을 일치시킨 일반 아동 10명으로 구성된 두 집단, 총 20명의 아동을 대상으로 하였다.

HF-ASD 아동은 Tsai (1992)의 기준을 참조하여 1) 전문의에 의해 DSM-5 진단기준에 따라 ASD로 진단된 아동 중 2) 한국 카우프만 아동용 지능검사(Korean Kaufman Assessment Battery for Children, K-ABC; Moon & Byun, 1997)의 비언어성 검사(손동작, 삼각형, 시각유추, 위치기억, 사진순서)에서 비언어성 지능점수 70점 이상 그리고 3) 부모가 신체 및 운동성, 시각, 청각에 문제가 없다고 보고한 경우이며, 일반 아동은 1) K-ABC의 비언어성 지능점수가 85점 이상, 2) 수용 ·표현어휘력검사(Receptive and Expressive Vocabulary Test, REVT; Kim, Hong, Kim, Jang, & Lee, 2009)에서 수용 및 표현어휘 점수가 모두 -1.25 SD 이상 그리고 3) 부모가 신체, 정서, 사회성, 신경, 인지, 언어, 시청각 등의 발달영역에 문제가 없다고 보고한 경우이다. 이외에 두 집단 공통적으로 부모보고 및 연구자의 확인을 통하여 1) 기쁘다, 슬프다, 화나다, 놀랍다에 대한 어휘를 이해하며, 2) 착석 유지, 지시따르기, 컴퓨터 화면 응시 유지, 1-4의 숫자 읽고 답하기가 가능하고, 3) 안경형 아이트래커 착용이 가능한 경우였다.

두 집단의 생활연령 및 비언어성 지능의 평균 간 차이 검증을 위한 독립표본 t 검정 분석 결과, 유의수준 .05에서 유의한 차이가 나타나지 않았다. 연구 대상자의 정보는 Table 1과 같다.

연구도구정서인식 과제는 기쁘다, 슬프다, 화나다, 놀랍다의 정서별로 1개씩 총 4개 문항으로 구성하고 동영상과 사진의 두 가지 자극유형으로 제작하였다. 각 자극의 크기는 16.0 × 16.0 (cm2)로 목부터 머리와 얼굴을 촬영하였다. 얼굴은 정면을 향하도록 하고, 표정이 잘 보이도록 머리카락은 짧고 눈썹 전체가 보이도록 하였다. 아동들이 얼굴 표정에서 나타나는 정서를 파악할 때 성인보다 또래의 얼굴에서 더 정확도가 높다는 선행연구 결과(Anastasi & Rhodes, 2005)에 근거하여 자극의 모델은 연구 대상자 연령과 유사한 8-10세 일반 아동(1명)으로 선정하였다.

정서유형에 적절한 아동 모델의 표정을 유도하기 위해 먼저 우리나라 성인의 기본 정서에 대한 얼굴 표정 모음집인 고려대학교 얼굴 표정 모음집(Korea University Face Expression Collection, KUFEC; Lee, Lee, Lee, Choi, & Kim, 2006: as cited in Kim, Choi, & Cho, 2011)에 수록된 사진을 아동 모델에게 미리 보여준 뒤, 이를 참고하여 표정을 연출하도록 연습을 시켰다. 이후 가능한 자연스러운 표정으로 정서를 표현하는 모습을 동영상으로 촬영하였다. 촬영된 동영상 중 동영상 자극은 연구자가 1차적으로 가장 적절하게 정서가 표현된 구간을 정서별로 1초 길이로 잘라서 선정하고, 사진 자극은 동영상 자극 중 가장 적절하게 정서가 표현된 순간을 캡처하여 제작하였다. 이후 언어치료학을 전공하는 석사과정 대학원생 5명을 대상으로 두 자극유형별로 정서표현에 대한 과제 타당도 검사를 실시하였다. 타당도 검사는 AOI 설정의 타당성을 위해 각 자극으로 사용된 얼굴을 정서별로 전체 얼굴, 눈 주위, 입 주위로 나누어 제시하고, Likert 5점 척도(1= 매우 부적절, 2 = 부적절, 3 =보통, 4 = 적절, 5 = 매우 적절)로 정서표현의 적절성을 평가하도록 하였다. 타당도 실시 결과 4점 이상인 자극으로만 선별하였으며, 선정된 자극들의 평균은 얼굴 전체 4.95점, 눈 주위 4.95점, 입 주위 4.9점이었다. 또한 아동들 대상으로 정서인식에 대한 자극의 적절성 검증을 위해 기본 정서가 습득된 연령인 12-13세의 일반 아동 3명에게 연구 대상자들에게 실시한 동일한 방법으로 자극별로 정서인식 평가를 실시한 결과 정반응률이 100%로 나타났다.

본 연구에서 사용한 시선추적기는 (주)토비테크놀로지코리아에서 제조한 안경형 아이트래커 Tobii Pro Glasses2 (2세대 웨어러블 아이트래커)를 사용하였다. 안경형 아이트래커는 사람이 지각하지 못하는 적외선을 눈에 투사하여 반사되는 신호를 통해 시선의 움직임을 추적하는 장치로 대상자가 일반 안경처럼 착용하는 기기이다. 실험 동안 초당 50 Hz의 높은 시간 해상도로 대상자의 자발적 안구 운동 데이터를 측정한 후, Tobii Pro Lap 분석 프로그램을 사용해 수집된 데이터를 확인하였다. 모니터(모델명 LG22V24)는 48 × 27 (cm2)를 사용하였다.

연구절차본 연구는 나사렛대학교 생명윤리위원회(IRB)의 승인(IRB-나사렛대-2021-30)을 받아 진행하였다.

연구 대상자 모집을 위해 연구자는 장애 전담 어린이집, 아동 발달 센터, 복지관, 온라인 커뮤니티에 모집 공고문을 게재하였다. 연구자가 공문에 선정기준을 제시하고, 지원자 중 전화면담을 통해 대상자 가능자로 판단된 경우 대면으로 비언어성 지능검사 및 어휘 능력 검사를 진행하였다. 모든 검사 결과 대상자로서 적합하다고 결정되면 대상자로 선정하고, 서면 동의를 거쳐 실험 과제를 진행하였다.

실험은 연구자가 소속된 기관이나 대상자의 거주지에서 독립적이고 조용한 방에서 개별적으로 약 15분 내외로 1회 실시하였다. 연구자는 모니터와 아동 간의 거리가 아이트래커로 아동의 시선을 정확하게 측정할 수 있는 거리인 60-70 cm가 되도록 의자를 준비하고 아동을 착석하게 한 후, 보호자의 도움 하에 안경형 아이트래커를 착용하도록 하였다. 이후 아동이 과제를 수행하는 동안 몸을 의자 등받이에 최대한 고정하도록 하고, 응답할 때 몸을 기울이지 않도록 지시한 뒤에 모니터에 제시되는 점을 응시해 안구의 위치를 확인하는 절차인 시선 보정(Calibration)을 실시하였다. 보정 완료 후에 연습 문항을 실시한 이후 정서인식 과제를 실시하였다.

과제는 컴퓨터 모니터로 PowerPoint로 제시하였다. 자극 제시의 순서효과를 배제하기 위하여 정서유형의 제시 순서는 엑셀의 random 함수를 이용하여 무작위로 배열하였으며, 자극유형의 제시 순서도 집단 간 대상자별로 사진과 동영상의 제시 순서를 역균형화하였다.

각 문항의 보기는 4개이며, 순서효과를 통제하기 위해 보기 순서는 엑셀의 random 함수를 이용하여 무작위로 1차 배열한 후, 연구자가 한 집단 내에서 하나의 정서유형이 동일한 위치에 4번을 초과하지 않도록 하고, 연속한 문항에서 동일한 유형이 나타나지 않도록 재배열하였다.

연구자는 본 문항 실시 전에 아동에게 제시되는 자극을 잘 살펴보고, 지시문이 나온 뒤에 제시되는 네 개의 보기 중에서 지시문에 적합한 것을 번호로 응답하거나 손으로 가리키는 과제임을 설명하였다. 이후 아동이 잘 이해했는지 확인하기 위하여 과제 진행 절차와 동일하게 연습 문항을 실시하였다. 연습 문항은 본 평가에 미치는 영향을 차단하기 위해 얼굴 이모티콘으로 진행하였으며, 목표 정서 어휘가 아닌 ‘우는 얼굴’과 같이 표정을 설명하는 용어로 제시하고, 정서가 표현되지 않은 중립적인 보기들을 사용하였다.

본 과제는 정서별로 4초씩 차례대로 제시한 후에 녹음된 지시문(예, 기쁜 얼굴은 몇 번인가요?)을 들려주고, 네 개의 정서유형을 동시에 8초 동안 제시하고 답을 고르도록 하였다. 정서유형 간에는 보정화면을 1초간 삽입하여 모든 정서유형에서 시선의 시작 위치가 동일하도록 하였다. 정서인식 과제 진행의 예시는 Figure 1에 제시하였다.

자료 분석정서인식에 대한 반응 분석각 문항당 정반응은 1점, 오반응은 0점으로 처리하여 정반응률(전체 정반응률, 정서유형별 정반응률, 자극유형별 정반응률)을 분석하였다. 전체 정반응률은 사진 4문항, 동영상 4문항에서 정반응한 수를 총 문항 수(8)로 나눈 후 100을 곱하여 산출하였다. 정서유형별 정반응률은 정서별로 사진 1회, 동영상 1회에서 정반응한 수를 정서별 제시 총 수(2)로 나눈 후 100을 곱하여 산출하였다. 자극 유형별 정반응률은 사진과 동영상 자극유형별로 정반응한 수를 각 자극유형의 총 문항(4)로 나눈 후 100을 곱하여 산출하였다.

정반응률 이외에도 사진과 동영상 자극별로 오반응을 보인 문항에 대해 정서유형별 오답 빈도를 분석 후 정서유형을 쾌차원(기쁘다, 놀랍다)과 불쾌차원(슬프다, 화나다)으로 분류하여 오류 형태를 분석하였다.

시선고정비율 분석수집된 아이트래킹 데이터 중 두 눈의 시각 정보가 올바르게 식별된 정도인 Gaze sample이 75% 이상인 데이터만을 선정한 후(Bergstrom & Schall, 2014), Tobii Pro Lab 프로그램을 이용하여 분석하였다. 개별 자극에 대한 AOI 영역을 설정한 후, 아동의 시선응시 데이터를 제시한 과제 자극물에 Mapping하는 과정을 거쳤다. AOI는 제시된 얼굴 내에서 (1) 눈 주위(눈, 눈썹, 미간을 포함), (2) 입 주위(입술, 입 주위의 볼까지 포함), (3) 그 외 얼굴(눈, 입 주위를 제외한 나머지 얼굴 영역), (4) 얼굴 이외(모니터 화면에서 전체 얼굴 이외 모든 영역)로 총 4개 영역으로 세분화하였다(Figure 2).

시선응시 데이터는 정서인식 과제 수행 시 아동이 착용한 아이트래커를 통해 측정하였다. 정서별로 4초간 자극이 제시되는 동안 각 AOI에 대한 아동의 총 시선고정시간(total fixation duration)을 분석한 뒤 이를 시선고정비율(proportion of fixation)로 환산하였으며, 시각 자료인 heatmap을 분석하였다. 시선고정이란 대상자가 특정 영역을 일정 시간 이상 지속해서 응시하는 것을 말하며, 시선고정이 일어나는 동안 높은 수준의 인지 처리가 이루어지고 있음을 의미한다. Rayner (1997)는 평균 200-250 ms 간의 시선고정을 통해 정보를 얻게 된다고 보고하였다. 본 연구에서도 최근 대다수의 시선추적 연구에서 설정하는 200 ms을 기준으로 그 이상 AOI를 응시한 경우에만 분석에 포함하였다. 시선고정비율은 정서별로 각 AOI (눈 주위, 입 주위, 그 외 얼굴, 얼굴 이외)에 대상자가 응시한 총 시간을 초로 환산하여 자극 제시 시간인 4초로 나눈 후 100을 곱하여 산출하였다.

통계처리본 연구 자료의 통계처리는 SPSS version 22.0 (IBM, Armonk, NY, USA)을 사용하여 분석하였다.

정서인식 정반응률에서 대상자 집단 간 차이와 집단, 자극유형 및 정서유형 간 상호작용 효과를 분석하기 위하여 반복측정을 통한 삼원분산분석(three-way ANOVA)을 실시하였다. 자극유형과 정서유형에 따른 집단 간 정서인식 정반응률에 대한 차이 검증은 각각 독립표본 t 검정을 실시하였고, 집단 내 정서인식 정반응률에 대한 차이 검증은 반복측정을 통한 이원분산분석(two-way ANOVA)을 실시하였다.

시선고정비율에서 집단, 정서유형 및 AOI 간 상호작용 효과를 분석하기 위하여 반복측정을 통한 삼원분산분석을 실시하였다. 정서유형과 AOI에 따른 집단 간 시선고정비율에 대한 차이 검증은 각각 독립표본 t 검정을 실시하였고, 집단 내 시선고정비율에 대한 차이 검증은 반복측정을 통한 이원분산분석을 실시하였다.

또한, 정서인식의 정서유형별 정반응률과 집단 및 시선응시관련 변인들 간의 상관분석을 위하여 Pearson 상관분석을 실시하였다. 집단 변인은 HF-ASD는 1, TD = 2로 코딩하여 Point-biserial correlation을 실시하였다.

연구결과정서인식 정반응률 분석 결과집단, 정서유형 및 자극유형에 따른 정서 인식 정반응률 기술통계 결과는 Table 2와 같다.

집단 간 정서인식 전체, 자극유형, 정서유형에 따른 정반응률 차이 및 상호작용 효과 분석 결과반복측정을 통한 삼원분산분석을 실시한 결과, 정서인식 전체 정반응률에서 HF-ASD 아동 집단이 일반 아동 집단에 비해 유의하게 낮은 수준을 나타냈다(F(1, 18) = 5.19, p=.035). 집단과 자극유형 간(F(1, 18) =.72, p=.408), 집단과 정서유형 간(F(3, 54) =1.90, p=.140), 집단과 자극유형 및 정서유형 간(F(3, 54) =.45, p=.717)에서 상호작용 효과가 모두 나타나지 않았다.

집단 내 자극유형과 정서유형에 따른 정반응률의 차이 및 상호작용 효과 검증 결과집단별로 반복측정을 통한 이원분산분석 실시 결과, HF-ASD 아동 집단은 자극유형별(F(1, 9) =1.38, p=.269), 정서유형별(F(3, 27) = 2.43, p= .087) 변인들 간에 유의한 차이를 보이지 않았다. 또한 자극유형과 정서유형 간 상호작용 효과가 나타나지 않았다(F(3, 27) =.37, p=.772). 일반 아동 집단도 자극유형별(F(1, 9) =1.00, p=.343), 정서유형별(F(3, 27) =1.00, p=.408) 변인들 간 유의한 차이가 없었으며, 자극유형과 정서유형 간 상호작용 효과가 나타나지 않았다(F(3, 27) = 1.00, p= .408).

두 집단의 오류 형태 분석 결과HF-ASD 아동 집단과 일반 아동 집단의 오류 유형 특성을 사진과 동영상 자극으로 나누어, 집단별로 정서유형에 대한 오류 반응을 정서별 및 쾌차원(기쁘다, 놀랍다)과 불쾌차원(화나다, 슬프다)으로 분류하였다(Figure 3).

분석 결과, 일반 아동 집단은 동영상 자극에서만 쾌차원의 ‘기쁘다’를 쾌차원의 ‘놀랍다’로 1회 오류를 보인 반면, HF-ASD 아동 집단은 사진에서 5회, 동영상에서 9회로 총 14회의 오류가 나타났는데, 동일 차원 간 오류는 쾌차원 간 오류 2회, 불쾌차원 간 오류 5회였으며, 쾌차원을 불쾌차원으로 반응한 역차원 간 오류가 4회, 무반응이 3회로 나타났다.

자극유형별 시선고정비율 분석 결과집단, 정서유형 및 AOI에 따른 시선고정비율을 사진 자극과 동영상 자극으로 나누어 통계 분석을 실시한 결과는 다음과 같다.

사진자극시선고정비율 평균 및 시선추적 열지도 분석 결과전체 정서에서 AOI에 따른 시선고정비율의 평균은 일반 아동 집단이 눈 주위(35.01%), 입 주위(23.15%), 얼굴 이외(21.91%), 그 외 얼굴(19.93%) 순인 반면, HF-ASD 아동 집단은 얼굴 이외(32.02%), 입 주위(25.37%), 그 외 얼굴(22.25%), 눈 주위(20.36%) 순으로 눈 주위 응시비율이 가장 낮았다.

정서유형별로는 일반 아동들은 모든 정서유형에서 입보다 눈 주위에 더 높은 시선고정비율을 보인 반면, HF-ASD 아동들은 화나다만 눈에 대한 시선고정비율이 더 높았으나 일반 아동들과 큰 차이를 나타냈다. 화나다에서 일반 아동들의 눈 주위 비율은 50.63%로 매우 높은 반면, HF-ASD 아동들은 얼굴 이외 영역이 32.25%로 가장 높고 눈 주위는 26.98%였다. 또한 기쁘다에서 일반 아동들은 눈 주위가 30.96%로 가장 높고, 얼굴 이외는 17.85%로 가장 낮은 반면, HF-ASD 아동들은 얼굴 이외가 42.42%로 매우 높고, 눈은 16.94%로 가장 낮았다. 구체적인 두 집단의 정서유형별 AOI에 따른 시선고정비율 평균과 시선추적 열지도 분석 결과는 Figure 4와 같다.

집단, 정서유형, AOI 간 시선고정비율의 상호작용 효과 분석 결과반복측정을 통한 삼원분산분석 결과, 집단과 정서유형 간(F(3, 54) =.29, p=.831), 집단과 AOI 간(F(3, 54) =1.02, p=.39), 집단과 정서 유형 및 AOI 간(F(9, 162) =1.57, p=.128)에서 상호작용 효과가 모두 나타나지 않았다.

집단 간 정서유형별 AOI에 따른 시선고정비율의 차이 검증 결과독립표본 t 검정 결과(Table 5), HF-ASD 아동 집단이 일반 아동에 비해 ‘기쁘다’의 ‘얼굴 이외’ 영역에 대한 시선고정비율이 유의하게 높았다(t = 2.384, p= .034). 그 외의 정서들은 집단 간 유의한 차이가 나타나지 않았다.

두 집단이 ‘기쁘다’에서 나타낸 AOI별 시선고정비율의 구체적 패턴을 그래프로 분석한 결과(Figure 5), 얼굴 이외 부위에 대한 시선고정비율의 분포가 일반 아동 집단은 41.34% 이하로 나타낸 반면, HF-ASD 아동 집단은 .71-89.51%로 넓은 분포를 보였다.

집단 내 정서유형과 AOI에 따른 시선고정비율의 차이 및 상호작용 효과 검증 결과집단별로 반복측정을 통한 이원분산분석을 실시한 결과, HF-ASD 아동 집단에서 정서유형(F(3, 27) =.47, p=.703)과 AOI에 대한 주효과(F(3, 27) =.70, p=.563) 및 정서유형과 AOI 간 상호작용 효과가 없었다(F(9, 81) =1.07, p=.398).

일반 아동 집단도 시선고정비율에 대한 정서유형별 주효과(F(3, 27) =.14, p=.932)와 AOI에 대한 주효과(F(3, 27) =.67, p=.577)는 유의하지 않았으나, 정서유형과 AOI 간 상호작용 효과가 나타났다(F(9, 81) = 2.09, p=.04). 상호작용 효과 그래프를 분석한 결과(Figure 6), ‘기쁘다’, ‘화나다’, ‘놀랍다’에서 눈 주위가 가장 높은 시선고정비율을 보인 반면, ‘슬프다’는 그 외 얼굴이 가장 높았다. ‘기쁘다’는 눈, 그 외 얼굴, 입, 얼굴 이외, ‘화나다’는 눈, 입, 얼굴 이외, 그 외 얼굴, ‘놀랍다’는 눈, 얼굴 이외, 입, 그 외 얼굴의 순이었으며, ‘슬프다’는 그 외 얼굴, 얼굴 이외, 눈, 입의 순이었다.

동영상자극시선고정비율 평균 및 시선추적 열지도 분석 결과전체정서에서 AOI에 따른 시선고정비율의 평균은 일반 아동 집단이 입 주위(38.06%), 그 외 얼굴(27.30%), 눈 주위(24.39%), 얼굴 이외(10.25%), 순인 반면, HF-ASD 아동 집단은 입 주위(41.38%), 그 외 얼굴(20.15%), 얼굴 이외(19.92%), 눈 주위(18.55%) 순으로 눈 응시비율이 가장 낮았다.

정서유형별로는 일반 아동들은 화나다와 놀랍다에서는 눈과 입보다 표정 주름이 생기는 코 주변과 같은 그 외의 얼굴 영역의 비율이 가장 높았고, 기쁘다와 슬프다에서는 입의 비율이 가장 높았다. 반면, HF-ASD 아동 집단은 모든 정서에서 입이 가장 높았다. 화나다의 경우 일반 아동들이 그 외 얼굴 37.95%, 눈 주위 28.63%, 입 주위 25.15%, 얼굴 이외 8.27%의 형태를 보인 반면, HF-ASD 아동들은 입 주위가 34%로 가장 높고, 그 외 얼굴 24.63%, 눈 주위 21.70%, 얼굴 이외 19.67%의 형태로 상당한 차이를 보였다. 또한 기쁘다의 경우, 두 집단이 모두 입의 비율이 약 55-57%로 매우 높았으나, 일반 아동들이 얼굴 이외가 6.72%로 매우 낮은 반면, HF-ASD 아동들은 21%로 상당히 높았으며, 눈 주위는 일반 아동들이 22.53%인 반면, HF-ASD 아동들은 10.82%로 매우 낮았다. 구체적인 두 집단의 정서유형별 AOI에 따른 시선고정비율 평균과 시선추적 열지도 분석 결과는 Figure 7과 같다.

집단, 정서유형, AOI 간 시선고정비율의 상호작용 효과 분석 결과반복측정을 통한 삼원분산분석 결과, 집단과 정서유형 간(F(3, 54) =1.54, p=.216), 집단과 AOI 간(F(3, 54) =.47, p=.708), 집단과 정서유형 및 AOI 간(F(9, 162) =.37, p=.947) 상호작용 효과도 나타나지 않았다.

집단 간 정서유형별 AOI에 따른 시선고정비율의 차이 검증 결과독립표본 t 검정 실시 결과(Table 6), HF-ASD 아동 집단이 일반 아동에 비해 ‘기쁘다’의 ‘얼굴 이외’ 영역에 대한 시선고정비율이 유의하게 높았다(t = 2.352, p= .040). 그 외의 정서들은 집단 간 유의한 차이가 없었다.

두 집단이 ‘기쁘다’에서 나타낸 AOI별 시선고정비율의 구체적 패턴을 그래프로 분석한 결과(Figure 8), 얼굴 이외 부위에 대한 시선고정비율의 분포가 일반 아동 집단은 14.75% 이하로 나타낸 반면, HF-ASD 아동 집단은 3-62.5%로 넓은 분포를 보였다.

집단 내 정서유형과 AOI에 따른 시선고정비율의 차이 및 상호작용 효과 검증 결과집단별로 반복측정 이원분산분석 실시 결과, HF-ASD 아동 집단은 정서유형에 대한 주효과(F(3, 27) =1.00, p=.408)와 AOI에 대한 주효과(F(3, 27) =1.52, p=.233) 및 정서유형과 AOI 간 상호작용효과가 없었다(F(9, 81) =1.48, p=.171).

일반 아동 집단 분석 결과, 정서유형에 따른 주효과(F(3, 27) = 2.30, p=.100)와 AOI에 따른 주효과(F(3, 27) = 2.29, p=.101)가 없으며, 정서유형과 AOI 간 상호작용효과는 유의하였다(F(9, 81) = 2.02, p=.047). 상호작용 효과 그래프를 분석한 결과(Figure 9), 유형별로는 ‘기쁘다’, ‘슬프다’에서 입 주위에 가장 높은 시선고정비율을 보인 반면, ‘화나다’와 ‘놀랍다’는 그 외 얼굴이 가장 높았다. ‘기쁘다’는 입의 비율이 다른 부위에 비해 크게 높았으며, 그 다음은 눈, 그 외 얼굴, 얼굴 이외의 순이었다. ‘슬프다’는 입의 응시 비율이 상대적으로 높고, 그 외 얼굴, 눈, 얼굴 이외의 순이었다. ‘화나다’는 그 외 얼굴, 눈, 입, 얼굴 이외의 순이었는데, 얼굴 이외의 비율은 다른 영역에 비해 상대적으로 크게 낮았다. ‘놀랍다’는 그 외 얼굴, 입, 눈, 얼굴 이외의 순이었다.

집단, 정서유형 정반응률 및 자극유형별 AOI의 시선고정비율 간의 상관관계 분석 결과각 자극에서 집단, 정서유형별 정반응률, 시선고정비율 간의 상관관계 분석을 위하여 집단 변인을 HF-ASD 아동 집단은 1, 일반 아동 집단은 2로 코딩하여 Point-biserial correlation을 실시하였다. 상관관계 분석결과(Table 7), 집단과 ‘화나다’의 정반응률 간 정적상관을 보였다. 자극유형별로 사진에서는 유의한 상관관계가 나타나지 않았으며, 동영상 자극에서 ‘기쁘다’와 ‘얼굴 이외’(r = -.595 , p<.01) 간, ‘화나다’와 ‘얼굴 이외’(r = -.463 , p<.05) 간, ‘놀랍다’와 ‘얼굴 이외’(r = -.593 , p<.01) 간에 유의한 부적상관이 나타났다.

논의 및 결론본 연구는 7-8세 HF-ASD 아동 집단의 또래 아동 얼굴표정에 대한 정서인식 특성을 살펴보는데 목적이 있었다. 이를 위하여 정서유형과 자극유형에 따른 정서인식 정답률과 시선추적기를 활용한 AOI에 따른 시선고정비율의 특성을 동일 생활연령의 일반 아동 집단과 비교 분석하고, 정서유형별 정반응률 및 AOI의 시선고정비율 간의 상관관계를 분석하였다. 연구결과에 대한 논의는 다음과 같다.

첫째, 본 연구에서 7-8세 HF-ASD 아동 집단은 정서인식 전체 정반응률에서 일반 또래 집단보다 유의하게 낮은 수준을 나타냈다. 이러한 결과는 HF-ASD 아동들이 얼굴표정에서 나타나는 정서인식 능력에 결함을 보인다는 선행연구들과 일치한다(Lindner & Rosen, 2006; Lozier et al., 2014; Rump, Giovannelli, Minshew, & Strauss, 2009). 특히 Lindner와 Rosen (2006)는 언어 단독, 언어와 얼굴표정 그리고 얼굴표정 단독 제시 과제 간 비교를 통하여 5-16세 아스퍼거 증후군 집단이 얼굴표정 단독 단서만으로 기쁨, 슬픔, 놀람과 같은 기본 정서를 인식하는 것에 언어 단서보다 상대적으로 더 큰 어려움이 있음을 입증한 바 있다.

정서유형별 집단 간 비교 결과, ‘화나다’의 정서인식에서 HF-ASD 아동 집단이 일반 아동 집단보다 통계적으로 유의하게 낮은 정답률을 보였다, 이는 ASD 집단이 정서유형들 중 긍정적 정서보다 화남이나 두려움 같은 부정적 정서의 인식에서 더 큰 결함이 있음을 보고한 선행연구들(Ashwin et al., 2006; Bal et al., 2010; Chae & Hong, 2015; Rump et al., 2009; Smith, Montagne, Perrett, Gill, & Gallagher, 2010)과 일견 일치한다. 그러나 Rump 등(2009)에서 5-7세 HF-ASD 아동들이 두려움과 화남의 정서인식에서 일반 또래에 비해 유의하게 낮은 수준을 보였고 기쁨에서도 유의하지 않지만 낮은 평균을 보였다고 보고한 바와 같이 본 연구에서도 ‘기쁘다’의 정서인식에서 HF-ASD 아동들이 일반 아동들에 비해 상당히 낮은 정답률을 나타냈다. 이러한 결과들은 일반적으로 일반 아동들은 기본 정서유형 중 기쁨을 가장 빠르게 5-6세에 습득한다(Durand et al., 2007; Lawrence et al., 2015; Yi et al., 2012)는 점을 고려할 때, HF-ASD 아동들이 7-8세 경에도 얼굴표정을 통해 부정적 정서 유형의 인식뿐만 아니라 기쁨과 같은 더 이른 시기에 습득되는 정서인식에도 여전히 결함을 나타낼 가능성이 크다는 것을 제시한다.

둘째, 본 연구에서 사진과 동영상 자극 각각에서 정서인식 정반응률이 HF-ASD 아동 집단과 일반 아동 집단 간에 통계적으로 유의한 차이가 없었다. 7-18세 ASD 집단의 사진 자극에 대한 기본 정서들의 인식 수준을 분석한 Grossman 등(2000)도 이들이 일반 또래 집단과 차이가 없음을 보고하였다. 그러나 7-12세 ASD 아동들을 대상으로 사진과 동영상 자극 간 정서인식 수준을 분석한 Jelili 등(2021)은 이들이 기쁨은 두 자극에서 일반 아동들과 차이가 없었으나 슬픔은 사진 그리고 화남, 놀람은 두 자극 모두에서 일반 아동들보다 낮은 수준의 정서인식을 나타냈다고 보고하였다. 12-19세 고기능 ASD 집단을 대상으로 얼굴표정 변화의 제시 속도를 달리하여 정서유형별 인식 수준을 비교한 Smith 등(2010)은 놀람은 느린 속도, 화남은 느림-중간 수준에서 일반 청소년에 비해 낮은 수준을 나타냄을 확인하였다. 반면, Lindner와 Rosen (2006)에서는 5-16세 아스퍼거 아동들이 기쁨, 슬픔, 화남의 정서인식에서 두 자극 유형 모두 일반 아동들보다 낮은 수준을 나타냈다. 이처럼 자극유형에 따른 정서인식 정반응률에 대한 연구결과들은 상당히 혼재되어 있으며, 본 연구에서는 나타나지 않았지만 자극유형과 정서유형 간에 상호작용 효과가 있을 가능성을 강하게 시사하고 있다. 따라서 자극유형에 따른 정서인식은 충분한 후속연구들이 필요해 보인다.

셋째, 본 연구에서 두 집단의 오류 형태를 분석한 결과, HF-ASD 아동은 총 14회의 오류 중 쾌차원을 불쾌차원으로 4회 반응하는 다른 정서 차원 간 오반응을 나타낸 반면, 일반 아동은 쾌차원 내 오반응만 1회 나타났다. 일반 아동들은 정서 발달에서 일반적으로 쾌와 불쾌 두 차원에 근거하여 정서를 인식하며, 따라서 동일 차원 내에서 서로 인접한 정서끼리 혼동하는 체계적인 발달적 오류를 보인다(Bullock & Russell, 1984). 본 연구에서 일반 아동 집단의 오반응수가 제한적이기 하지만, HF-ASD 아동 집단이 나타낸 오류형태는 HF-ASD 아동들이 정서의 차원 간의 혼동을 보이며, 이는 정상발달에서 나타나는 발달적 오류와 다른 형태일 수 있음을 시사한다.

넷째, 정서유형에 따른 얼굴 영역에 대한 시선고정 특성을 분석한 결과, HF-ASD 아동 집단은 정서를 인식할 때 대체로 일반 아동들보다 눈 주위에 대한 시선고정비율이 낮으며, 얼굴 이외의 영역에 대한 응시 비율이 높았다.

자극유형별로 사진의 경우, 일반 아동들이 모든 정서유형에서 눈 주위에 가장 높은 시선고정비율을 보인 반면, HF-ASD 아동은 상대적으로 입에 대한 시선고정비율이 높았다. 열지도에서도 시선고정을 나타내는 붉은색이 일반 아동들과 달리 HF-ASD 아동들은 주로 입이나 턱 끝에 분포하여 눈 주위에서 충분한 단서를 얻지 못한다는 것을 반영하였다. 두려움, 놀람, 혐오, 화남과 같은 정서인식에서 눈 주위는 다른 정서와 구별하는 데 필요한 정보를 제공한다(Bal et al., 2010). Bal 등(2010) 연구에서 일반 아동 집단이 HF-ASD 아동 집단보다 사진으로 제시한 모든 정서유형에서 눈을 더 오래 응시하였는데, 눈을 오래 바라볼수록 두려움, 놀람 및 혐오를 더 정확하고 빠르게 인식하였다. 본 연구에서 일반 아동들보다 유의하게 낮은 정반응률을 나타낸 ‘화나다’의 경우, HF-ASD 아동들은 입보다 눈 주위에 대한 시선 분포가 더 높았으나, 시선고정비율은 일반 아동들이 나타낸 50%의 약 절반 수준으로 상대적으로 매우 낮았다. 3-13세 ASD 아동들이 사진 자극에서 부정적인 정서에서는 일반 아동들처럼 입보다 눈 주위에 더 긴 시선응시를 보였다는 선행연구들이 보고된 바 있다(de Wit, Falck-Ytter, & von Hofsten, 2008; Matsuda, Minagawa, & Yamamoto, 2015). 그러나 본 연구결과처럼 일반 아동보다는 상대적으로 낮은 눈에 대한 응시비율이 이러한 정서유형들의 인식에 어려움을 야기하는 주요 원인으로 해석해 볼 수 있다.

반면, 동영상 자극에서는 사진과는 달리 두 집단이 모두 눈보다 입 주위를 더 오래 응시하였다. HF-ASD 아동은 모든 정서유형에서 눈보다 입 주위에 대한 시선고정비율이 높았고, 일반 아동도 ‘화나다’를 제외한 다른 유형들에서 눈보다 입 주위의 비율이 더 높았다. 이는 정적인 사진보다 표정의 변화가 있는 동영상의 경우에 움직임이 큰 얼굴 주위에 아동들이 더 많이 집중한다는 Nelson과 Mondloch (2018)의 결과를 반영한다. 그러나 본 연구에서 ‘기쁘다’의 얼굴 이외의 영역에 대한 시선응시비율의 집단 차와 상호작용결과 그리고 시선추적 열지도 및 시선응시분포도 결과 등을 종합적으로 분석하면, 일반 아동들은 동영상에서도 주된 움직임이 있는 입 주위에 집중하면서도 정서 파악의 핵심 단서 영역인 눈에 충분한 응시를 나타내고, 그 외 미간, 콧등과 같은 얼굴의 주요 단서 영역에도 높은 응시를 나타낸 반면, HF-ASD 아동들은 정서유형에 상관없이 눈보다 입에 대한 응시비율이 훨씬 높고, 얼굴 이외의 영역을 많이 응시하는 특성을 보였다.

얼굴표정은 정서를 반영하는 가장 강력한 신호이며 따라서 타인의 정서를 이해하는 데 가장 중요한 단서이다. 얼굴표정에 나타난 정서인식의 근거가 되는 얼굴부위는 정서유형에 따라 차이가 있으며, 근거가 되는 부위에 시선을 집중하여 정서를 판단하는 능력은 일반적으로 연령의 증가에 따라 발달한다(Ambadar et al., 2005; Kostić et al., 2020; LaBarbera et al., 1976; Nelson & Dolgin, 1985; Walden & Field, 1982). 본 연구의 ASD 아동 집단과 일반 아동들의 시선응시 특성에 대한 비교 분석 결과는 ASD 아동들이 얼굴표정에 대한 정서를 파악할 때, 일반 아동들에 비하여 눈 주위의 시선응시가 적으며, 정서유형별로 주요 단서가 되는 얼굴 영역에 충분한 응시를 유지하지 못하고, 핵심적이지 않은 영역을 더 많이 응시했다는 선행연구들과 일치한다(Bal et al., 2010; Syeda et al., 2017). ASD 아동들이 일반적으로 타인과의 상호작용에서 나타내는 시선 맞추기에 대한 회피나 정서인식의 중요한 근거가 되는 얼굴영역에 대한 인식 부족 또는 중요한 정보에 주의를 집중하지 못하는 산만함 등의 결함이 정서인식 결함의 주요 원인이 될 수 있음을 보여준다. 본 연구의 상관관계 분석에서 ‘기쁘다’, ‘화나다’, ‘놀라다’의 정반응률이 얼굴이 아닌 영역에 대한 시선고정비율과 유의한 부적상관을 나타낸 점도 ASD 아동들의 이러한 시선응시 특성이 얼굴표정에 대한 정서인식 결함의 주요 원인임을 시사한다.

본 연구는 7-8세 HF-ASD 아동들이 나타내는 또래 얼굴표정에 대한 정서인식의 수준을 분석하고 시선 추적기를 사용한 객관적 자료를 사용하여 시선응시 패턴 측면에서 결함의 원인을 추론하였다. 본 연구결과는 언어치료 임상현장에서 ASD 아동들이 의사소통 상황에서 나타내는 또래인의 얼굴표정에 대한 정서인식의 특성을 평가하고 관련한 치료 목표와 전략을 설정하는데 유용한 기초 정보로 활용할 수 있을 것이다.

본 연구의 제한점을 고려한 후속연구에 대한 제언은 첫째, 연구 결과의 신뢰도를 높이기 위한 다수의 대상자 확보, 둘째, 연령대와 장애 중증도의 다양화, 그리고 셋째, 사진과 동영상 자극 간 비교 및 실제 사람 얼굴 대면자극을 포함한 정서인식 분석 연구들이다.

Figure 2.Example of AOI: ‘Eye’ in blue, ‘Mouth’ in red, ‘Other parts of the face’ in yellow, and ‘Out of the face’ in green.

Figure 4.Proportion of fixation and heatmap in static stimulus.

HF-ASD=high-functioning autism spectrum disorder; TD=typically developing children.

Figure 5.Group difference in proportion of fixation for ‘Happy’ in static stimulus.

HF-ASD=high-functioning autism spectrum disorder; TD=typically developing children.

*p < .05.

Figure 7.Proportion of fixation and heatmap in dynamic stimulus.

HF-ASD=high-functioning autism spectrum disorder; TD=typically developing children.

Figure 8.Group difference in proportion of fixation for ‘Happy’ in dynamic stimulus.

HF-ASD=high-functioning autism spectrum disorder; TD=typically developing children.

*p < .05.

Table 1.Participants’ characteristics

Table 2.Descriptive statistics of the accuracy in emotion recognition (%) Table 3.

t-test of accuracy according to stimuli types

Table 4.

t-test of accuracy according to emotion types

Table 5.

t-test of proportion of fixation to AOI by emotion types in static stimulus

Table 6.

t-test of proportion of fixation to AOI by emotion types in dynamic stimulus

Table 7.Correlations analysis

REFERENCESAmbadar, Z., Schooler, J. W., & Cohn, J. F. (2005). Deciphering the enigmatic face: the importance of facial dynamics in interpreting subtle facial expressions. Psychological Science, 16(5), 403–410.

Anastasi, J. S., & Rhodes, M. G. (2005). An own-age bias in face recognition for children and older adults. Psychonomic Bulletin & Review, 12(6), 1043–1047.

Ashwin, C., Chapman, E., Colle, L., & Baron-Cohen, S. (2006). Impaired recognition of negative basic emotions in autism: a test of the amygdala theory. Social Neuroscience, 1(3-4), 349–363.

Bal, E., Harden, E., Lamb, D., Van Hecke, A. V., Denver, J. W., & Porges, S. W. (2010). Emotion recognition in children with autism spectrum disorders: relations to eye gaze and autonomic state. Journal of Autism & Developmental Disorders, 40(3), 358–370.

Beaudry, O., Roy-Charland, A., Perron, M., Cormier, I., & Tapp, R. (2014). Featural processing in recognition of emotional facial expressions. Cognition & Emotion, 28(3), 416–432.

In J. R. Bergstrom, & A. Schall (Eds.), (2014). Eye tracking in user experience design Elsevier.

Bullock, M., & Russell, J. A. (1984). Preschool children’s interpretation of facial expressions of emotion. International Journal of Behavioral Development, 7(2), 193–214.

Chae, S., & Hong, K. (2015). Perception for aided-symbols depicting emotions in children with autism spectrum disorders. The Journal of Special Children Education, 17(3), 1–21.

de Wit, T. C., Falck-Ytter, T., & von Hofsten, C. (2008). Young children with autism spectrum disorder look differently at positive versus negative emotional faces. Research in Autism Spectrum Disorders, 2(4), 651–659.

Durand, K., Gallay, M., Seigneuric, A., Robichon, F., & Baudouin, J. Y. (2007). The development of facial emotion recognition: the role of configural information. Journal of Experimental Child Psychology, 97(1), 14–27.

Ekman, P. (1982). Methods for measuring facial action. In K. R. Scherer, & P. Ekman (Eds.), Handbook of methods in nonverbal behavior research (pp. 45–90). Cambridge: Cambridge University Press.

Enticott, P. G., Kennedy, H. A., Johnston, P. J., Rinehart, N. J., Tonge, B. J., Taffe, J. R., & Fitzgerald, P. B. (2014). Emotion recognition of static and dynamic faces in autism spectrum disorder. Cognition & Emotion, 28(6), 1110–1118.

Grossman, J. B., Klin, A., Carter, A. S., & Volkmar, F. R. (2000). Verbal bias in recognition of facial emotions in children with Asperger syndrome. The Journal of Child Psychology and Psychiatry and Allied Disciplines, 41(3), 369–379.

Hanawalt, N. G. (1944). The role of the upper and the lower parts of the face as a basis for judging facial expressions: II. In posed expressions and “candid-camera” pictures. The Journal of General Psychology, 31(1), 23–36.

Jelili, S., Halayem, S., Taamallah, A., Ennaifer, S., Rajhi, O., Moussa, M., ..., & Bouden, A. (2021). Impaired recognition of static and dynamic facial emotions in children with autism spectrum disorder using stimuli of varying intensities, different genders, and age ranges faces. Frontiers in Psychiatry, 12, 693310.

Kim, M. W., Choi, J. S., & Cho, Y. S. (2011). The Korea university facial expression collection (KUFEC) and semantic differential ratings of emotion. Korean Journal of Psychology General, 30(4), 1189–2111.

Kim, Y. T., Hong, G. H., Kim, K. H., Jang, H. S., & Lee, J. Y. (2009). Receptive & expressive vocabulary test (REVT) Seoul: Seoul Community Rehabilitation Center.

Kostić, S., Jakšić, T. T., & Tošković, O. (2020). Facial expressions recognition in photographs, drawings, and emoticons. Primenjena Psihologija, 13(3), 293–309.

LaBarbera, J. D., Izard, C. E., Vietze, P., & Parisi, S. A. (1976). Four-and six-month-old infants’ visual responses to joy, anger, and neutral expressions. Child Development, 47(2), 535–538.

Langdell, T. (1978). Recognition of faces: an approach to the study of autism. Journal of Child Psychology & Psychiatry, 19(3), 255–268.

Lawrence, K., Campbell, R., & Skuse, D. (2015). Age, gender, and puberty influence the development of facial emotion recognition. Frontiers in Psychology, 6, 1–14.

Lee, J. H., Park, S. J., Han, K. H., Ghim, H. R., & Cho, K. J. (2007). Effects of the facial expression presenting types and facial areas on the emotional recognition. Science of Emotion & Sensibility, 10(1), 113–125.

Lindner, J. L., & Rosén, L. A. (2006). Decoding of emotion through facial expression, prosody and verbal content in children and adolescents with Asperger’s syndrome. Journal of Autism & Developmental Disorders, 36(6), 769–777.

Lozier, L. M., Vanmeter, J. W., & Marsh, A. A. (2014). Impairments in facial affect recognition associated with autism spectrum disorders: a meta-analysis. Development & Psychopathology, 26(4pt1), 933–945.

Matsuda, S., Minagawa, Y., & Yamamoto, J. (2015). Gaze behavior of children with ASD toward pictures of facial expressions. Autism Research & Treatment, 1–8.

Moon, S. B., & Byun, C. (1997). Korean Kaufman assessment battery for children (K-ABC) Seoul: Hakjisa.

Nelson, C. A., & Dolgin, K. G. (1985). The generalized discrimination of facial expressions by seven-month-old infants. Child Development, 56(1), 58–61.

Nelson, N. L., & Mondloch, C. J. (2018). Children’s visual attention to emotional expressions varies with stimulus movement. Journal of Experimental Child Psychology, 172, 13–24.

Rayner, K. (1995). Eye movements and cognitive processes in reading, visual search, and scene perception. In J. M. Findlay, R. Walker, & R. W. Kentridge (Eds.), Eye movement research: Mechanisms, processes and applications (pp. 3–22). Amsterdam: North Holland.

Rayner, K. (1997). Understanding eye movements in reading. Scientific Studies of Reading, 1(4), 317–339.

Rump, K. M., Giovannelli, J. L., Minshew, N. J., & Strauss, M. S. (2009). The development of emotion recognition in individuals with autism. Child Development, 80(5), 1434–1447.

Shim, H. W., & Choi, K. S. (2001). Development of the discrimination of facial expressions by young children. The Korean Journal of Human Development, 8(1), 77–92.

Smith, M. J. L., Montagne, B., Perrett, D. I., Gill, M., & Gallagher, L. (2010). Detecting subtle facial emotion recognition deficits in high-functioning autism using dynamic stimuli of varying intensities. Neuropsychologia, 48(9), 2777–2781.

Syeda, U. H., Zafar, Z., Islam, Z. Z., Tazwar, S. M., Rasna, M. J., Kise, K., & Ahad, M. A. R. (2017). Visual face scanning and emotion perception analysis between autistic and typically developing children. In : In Proceedings of the 2017 acm international joint conference on pervasive and ubiquitous computing and proceedings of the 2017 acm international symposium on wearable computer; p. 844–853.

Tsai, L. Y. (1992). Diagnostic issues in high-functioning autism. In E. Schopler, & G. Mesibov (Eds.), High-functioning individuals with autism (pp. 11–40). New York: Plenum Press.

Yi, S. M., Cho, K. J., & Ghim, H. R. (2012). Developmental changes in reading emotional states through facial expression. The Journal of Developmental Psychology, 25(3), 55–72.

Uljarevic, M., & Hamilton, A. (2013). Recognition of emotions in autism: a formal meta-analysis. Journal of Autism & Developmental Disorders, 43(7), 1517–1526.

|

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||